AI-TCO neu gedacht: Warum der Kosten pro Token die einzige relevante Metrik ist

Die Transformation von Rechenzentren zu AI-Token-Fabriken

Traditionelle Rechenzentren dienten primär der Speicherung, Abrufung und Verarbeitung von Daten. In der Ära generativer und agentischer KI haben sich diese Einrichtungen radikal gewandelt: Sie sind zu AI-Token-Fabriken geworden. Der Hauptarbeitslast verschiebt sich zunehmend auf KI-Inferenz, deren primäres Output Intelligenz in Form von Tokens darstellt. Diese Paradigmenverschiebung erfordert eine Neubewertung der Ökonomie von AI-Infrastrukturen. Statt herkömmlicher Metriken wie FLOPs oder Rechenleistung pro Watt muss der Total Cost of Ownership (TCO) pro Token im Zentrum stehen.

Abbildung 1: Visualisierung der AI-Token-Fabriken (Quelle: NVIDIA Blog)

Diese Entwicklung ist durch den exponentiellen Anstieg der Inferenz-Anfragen bedingt. Während Trainingsphasen modell-spezifisch und zeitlich begrenzt sind, dominiert Inferenz den Betrieb mit kontinuierlicher Token-Generierung. NVIDIA betont in ihrem Blogbeitrag, dass AI-Fabriken ihre Effizienz nicht mehr an abstrakten Rechenmetriken messen sollten, sondern an der tatsächlichen Output-Qualität: Token pro Dollar.

Warum Kosten pro Token die TCO-Revolution einleitet

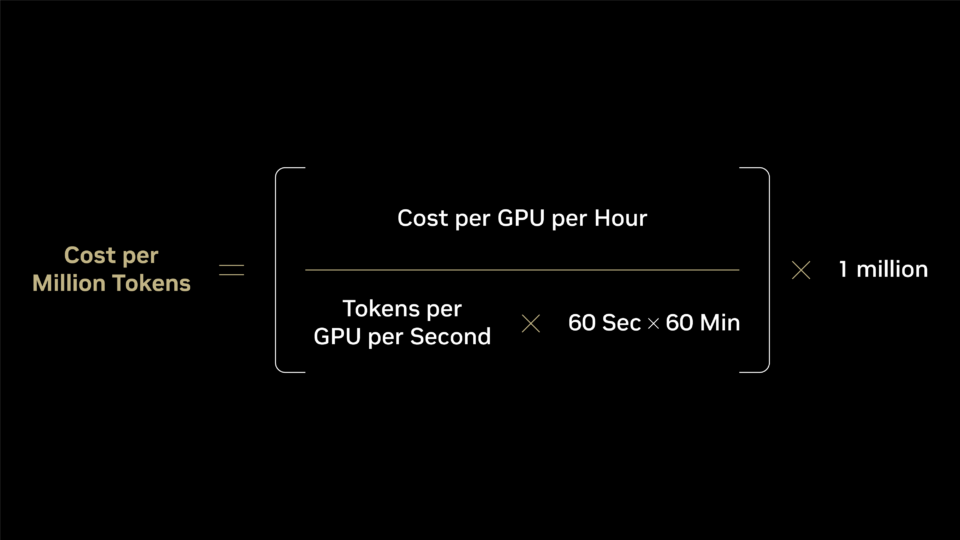

Der Kosten pro Token (Cost per Token) vereint alle relevanten Faktoren der AI-Infrastruktur: Hardwarekosten, Energieverbrauch, Kühlung, Netzwerk-Latenz und Software-Optimierung. Im Gegensatz zu legacy-Metriken wie PUE (Power Usage Effectiveness) oder Throughput in Tokens pro Sekunde berücksichtigt er den gesamten Lebenszyklus. Die Formel lautet vereinfacht:

[ \text{TCO pro Token} = \frac{\text{Gesamtkosten (CapEx + OpEx)}}{\text{Generierte Token pro Zeiteinheit}} ]

Abbildung 2: Detaillierte Gleichung für TCO pro Token (Quelle: NVIDIA Blog)

Diese Metrik offenbart Schwächen traditioneller Ansätze. Ein Datacenter mit hoher Rechenleistung kann teurer pro Token sein, wenn Inferenz-Optimierungen wie Quantisierung oder spekulative Dekodierung fehlen. NVIDIA hebt hervor, dass moderne GPUs wie die Blackwell-Architektur durch verbesserte Tensor-Cores und NVLink-Interconnects die Token-Produktion um Faktoren steigern, was den TCO senkt. Technologische Auswirkungen umfassen:

- Skalierbarkeit: AI-Fabriken müssen horizontale Skalierung priorisieren, um Token-Throughput zu maximieren.

- Energieeffizienz: Inference-lastige Workloads verbrauchen bis zu 80 % der Energie; Optimierungen wie FP8-Präzision reduzieren dies signifikant.

- Latenz-Optimierung: Agentische KI erfordert Echtzeit-Token-Generierung, was Netzwerk- und Speicher-Hierarchien neu gestaltet.

Abbildung 3: Vereinfachte Darstellung der Token-Kosten-Gleichung (Quelle: NVIDIA Blog)

Technologische Auswirkungen auf AI-Infrastruktur

Die Fokussierung auf Cost per Token treibt Innovationen in Hardware und Software voran. Inference Engines wie TensorRT-LLM optimieren Modelle für spezifische GPUs, reduzieren Token-Kosten um bis zu 50 % durch Batch-Optimierung und PagedAttention. Agentische Systeme, die Multi-Step-Reasoning erfordern, multiplizieren Token-Verbrauch – hier wird präzise TCO-Messung essenziell.

Zusätzlich ermöglicht diese Metrik Benchmarking neuer Architekturen. Vergleiche zeigen, dass Hopper- mit Blackwell-Systemen den TCO pro Token halbiert, dank höherer Token-per-Watt-Raten. Langfristig führt dies zu AI-Fabriken als Commodity, wo Wettbewerb rein token-ökonomisch entschieden wird. Im Jahr 2026, mit steigenden Energiekosten und Regulierungen (z. B. EU AI Act), wird Cost per Token zum regulatorischen Standard.

Für Entwickler impliziert dies ein Shift zu token-effizienten Modellen: Mixture-of-Experts (MoE) reduziert inaktive Parameter, senkt Kosten bei hohem Throughput. Cloud-Provider passen Preismodelle an, mit Pay-per-Token statt VM-Stunden.

Herausforderungen und Zukunftsperspektiven

Trotz Vorteilen birgt die Metrik Herausforderungen: Token-Qualität variiert je Modell und Prompt. Ein reiner Quantitätsfokus ignoriert Halluzinationen oder Kontexttreue. Zukünftige Erweiterungen wie Quality-Adjusted TCO pro Token könnten EVAL-Metriken (z. B. BLEU, ROUGE) integrieren.

Insgesamt markiert Cost per Token den Übergang zu einer token-zentrierten AI-Ökonomie, die Infrastrukturen auf Intelligenz-Produktion optimiert.

FAQ

Warum ersetzt der Kosten pro Token traditionelle Metriken wie FLOPs?

FLOPs messen Rohrechenleistung, ignorieren aber Inference-spezifische Faktoren wie Speicherbandbreite und Energie. Cost per Token quantifiziert den tatsächlichen Output-Wert, macht AI-Fabriken vergleichbar und wirtschaftlich nachhaltig.

Wie wirkt sich das auf den Betrieb agentischer KI aus?

Agentische Systeme generieren Ketten von Tokens (z. B. Reasoning + Action). Niedriger TCO pro Token ermöglicht skalierbare Deployment, reduziert Latenz und ermöglicht Echtzeit-Anwendungen wie autonome Agenten in Industrie 4.0.

Tags: #AI #Tech #AITCO #TokenFactories #NVIDIA #Inference